いまのAIは「アホ」なのか? ― たかがAI、されどAI

はじめに

学生にAI(人工知能)について聞くと、「AIに仕事を奪われるのではないか」と心配している人が多いことが分かる。仕事を奪われた結果、「簡単な仕事しか残らないのではないか」と、戦々恐々としている。しかし私は「AIはアホである」と思っているので、大学の授業でもそういう話をする。するとこんな感想が返ってくる。

1)「AIについてアホとおっしゃっていたのがとても印象にのこりました。」(著者註:確かに、AIをあからさまに「アホ」と呼ぶ人は聞いたことがない。)

2)「AIと人間に関して力説していた部分は本当に聞いていて面白く、AIによって今後の仕事等がどのように変化するのかを自分で調査してみたいと感じた。」

3)「わたしも、人間はAIに仕事を奪われてしまうのではないかと心配していましたが、今回の授業で、AIは帰納はできるが演繹(えんえき)はできないということが知れました。囲碁や将棋などの作業はできても、それを組み合わせて考える能力はないというように、まだ人間よりも随分と劣っているとわかり安心しました。」

4)「AIについてのお話も興味深く聞くことができました。証明方法に帰納法と演繹法がありますが、両方それぞれ証明ができるというわけではなく、どちらかでしか証明できないこともあるのだと考えると、何か不可解さが増します。」

私はいまのAIは「帰納」はできるが「演繹」は出来ない、まして「アブダクション」は出来ないと思っている。ここでいう「帰納」とは何か、「演繹」とは何か、「アブダクション」とは何なのか。以下では、これらの聞きなれない言葉の意味を説明しながら、いまのAIはどこが優れているのか、また、AIのどこが「アホ」なのか、振り返っておきたい。

考えるとはどういうことか

AIは知能の一種であるから「考える」ための機械ということになっている。考えるとはどういうことか。これを考えるためには、時代を400年ほど遡って、フランスの哲学者デカルトの『方法序説』という本まで戻ると分かりやすい。

『方法序説』の正式な題名は「理性を正しく導き、もろもろの学問において真理を求めるための」方法の序説である。この本の中でデカルトは、考えるための「4つの規則」を提唱した。この4つとは、明晰の規則、分析の規則、総合の規則、枚挙の規則。つまり問題を明晰に定義せよ、分析して一つ一つを解決してから総合せよ、最後に見落としをするな。この考え方が、いまの科学(すなわち分析という方法)にまで、つながるのである。それくらい単純明快で、強力な方法論だった。

『方法序説』が書かれた1637年の直前には、イタリアではガリレオの宗教裁判(1616年、1633年)があった。そんな時代の中で、この本はそれ以前の「宗教の時代」から、今の「科学技術と理性の時代」への転換点になった。実はこの過去400年間こそが、人間の理性と知性の時代にほかならない。

そして人工知能の出発点も、実はこのデカルトにまで遡ることができる。デカルトは心身二元論(心と身体の分離)を提唱し、考えることを独立させた(この「考える主体」をデカルトの「コギト」と呼ぶ。「我思う、ゆえに我あり」の我(われ)である)。デカルトはさらに、脳の機能の起源(大脳松果体)の研究や、動物の「機械論」まで提唱した。

この当時、すでにあった考え方は「演繹」だった。演繹というのは、ルール(少数の法則)を基礎にして、様々な付帯的条件と論理的推論を活用し、多数の様々な結論を導き出すという考え方である。例えば中学2年で習う図形の証明問題(自明な公理と推論だけから導く証明)や、演算規則を組み合わせて行う計算などが演繹である。古代ギリシャのユークリッド『幾何学原論』が演繹の典型であり、数学の多くが演繹である。日常生活でも三段論法など推論は多用される。

これに対して、「帰納」は比較的、新しい(実証的な科学方法論として17世紀イギリスのF.ベーコンに始まり、19世紀にJ.S.ミルが精緻化した)。「帰納」とは、様々で多様な事実やデータを多数集め、それらの系統性を調べることで、その背後にある法則性を推定する方法である。

人間が考えることの大部分は、この「演繹」と「帰納」に帰着するとされるが、実はもう一つあって、それがアブダクション(abduction)である。

英語では、演繹はディダクション(deduction)、帰納はインダクション(induction)である。両者に共通する-ductionは「導く」という意味である。これに対してabductionも-ductionが共通するが、ab-という接頭語はaway, from, off, downを意味する。このため普通abductionは拉致(誘拐)と翻訳される。無理に引っ張り込むという感じの言葉である。このabductionを、人間が考える第3の思考パターンとして使い出したのは、記号論学者のパースという人である。どこにもない発想を突然、天啓のごとく導き出すという意味である。言い換えればabductionは仮説形成である。アブダクションの例として、ニュートンの運動法則の発見が挙げられる。

以上で、人間の思考パターン(知能の類型)として、演繹、帰納、アブダクションという3つが出揃った。これを元にいまのAIは一体、何をやっているかを見ていこう。

結論からいうと、AIは帰納は得意だが演繹は苦手ということ、ましてやアブダクションは人間の足元にも及ばないこと。今後も出来るようになるかどうか分からない。しかし今後のことは分からない、だから人間はどうするか、といったことだ。

AIがアホである理由(1):機械学習の「最適化関数」が単純

マスコミ報道で伝わってくるAIのイメージは、人間を越え始めた、AIが何をやっているか作った人にも分からない、いや不気味だ、半分の仕事がAIに奪われる、といったものかもしれない。しかしAIも単なるソフトウェアに過ぎない。やっていることは単純であることを知る必要がある。いまのAIが機械学習でやっていることは、簡単にいうと次の3つである。恐れることはない。また不気味でもないことに、注意してほしい。

1)関数の表現:解きたい問題に対応する「最適化関数」を数式で表現する。ここで「最適化関数」は一般にコスト関数、目的関数、尤度(ゆうど)等と呼ばれ、その中に未知のパラメータを含む。つまり元の問題を、このパラメータの値を決定する問題に、帰着させる。この「最適化関数」の数学的表現は、発想・手順(アルゴリズム)を含む。このため種々の違いがあるように見える。しかし数学的表現に落とし込むという点では、どのAIも(例えばDeep Learning等のNeural NetworkもランダムフォレストもSVM(Support Vector Machine)も)共通している。

2)大量のデータ:その「最適化関数」の値を最大化するように、パラメータを決める。そのためにデータを使う(例えばDeep Learning等の場合は大量のデータ)。つまりある種の関数フィット(関数をデータに合わせること)をやっているだけだ。ただし近年のインターネットの発達のお陰で、使えるデータ量が劇的に増加して、以前は出来なかったことが出来るようになった。

3)高速の計算:この「最適化関数」の計算作業を高速コンピュータに、力任せにやらせる。近年の計算機の高速化で、この部分が昔に比べて劇的に楽になった。この結果、以前は出来なかったことが出来るようになった。

これが分かると、な~んだ、そんなことか!AIといっても大したことはやっていない!と驚くばかり。ここがまさに、AIが「アホ」と呼ばれる第1の理由である。例えば、パラメータの値がプログラムを書いた本人にも理解できない場合があるというが、そんなことは当たり前だ。「最適化関数」を最大化するための個々のパラメータの値には、元々意味がない場合もあるのに、それをあたかも恐怖であるかのように報道するのは「喜劇」である。「幽霊の、正体見たり、枯れ尾花」と知っているのに、いつまでもそれを「幽霊」と言っているようなものだ。

もっとも、以前は出来なかったことが出来るようになった点は、評価すべきである。しかしAIといえども、簡単なことしかやってない。その計算の意味やアルゴリズムの中身を理解しないまま行われるマーケティング戦略には、だまされてはいけない。

AIがアホである理由(2):帰納しか出来ない

次に注目すべきことは、いまのAIは「学習」で賢くなっているために、データがないと何も出来ないことだ。つまり「AIも、データなければ、ただの箱」。この事実は、いまのAIは帰納をやっていることを意味する。

いまのAIは、多くのデータから法則性を推定(帰納)しているだけだ。ただし、この部分で人間より上手くできるようになってきた。私が子どもの頃は、計算機は(人間には簡単な)パターン認識が、出来ないといっていた。隔世の感がある。

しかしそれも当たり前だ。なぜならインターネット上には気が遠くなるほど大量のデータが溢れかえり、コンピュータも昔の何億倍も高性能(高速)になり続けているからだ。そこまで変わると、新時代が来ない方がおかしい。時代の前提が変わったのだ。(もちろん、Deep Learningアルゴリズムを考えたジェフリー・ヒントン教授や、その前にネオコグニトロンを発明していた福島邦彦氏に敬意を表する上で、私も人後に落ちるものではないのだが)。

しかし、それでは、AIに演繹は、出来るのだろうか。それが、出来ていないのである。なぜ出来ていないのか。一見、不思議ではないだろうか。

この理由は、「意味」という言葉一つをとってみるだけで明白だ。いったい、意味に意味があるのはなぜなのか。考えたことがあるだろうか。おそらく意味の意味を説明できる人間はいないのではないか。

なぜなら同じデータ(同じ文字列、同じ文章、同じ言葉、同じ画像、同じ記憶)でも、それが持つ意味は人によって、また時によって違うからである。またその意味で、「意味」というものはそのデータを受け取る人の知識や感情その他、に依存するからである。また誰も、自分の知識も常識も感情も、言葉では表現しきれないからである。分かりやすい例をいうと、あることの意味が瞬間的に変化することがある(例えば、ある瞬間に誰かを好きになる)。これはなぜなのか。

一般に、演繹を行うためには、最初の法則が判明明晰に(デカルト流に)定義されていなければならない。それに加えて、その途中の論理的推論もすべて飛躍なく、解決可能な個々の過程に、分析(分解)できなければならない。さらに途中で暗黙の前提となる(この意味でしばしば省略される、あるいは常識としての)前提条件もすべて言葉にして、定義しなければならない。そうでなければ、推論マシン(推論ができる演繹AIコンピュータ)は回答にたどり着けない。しかし実は、そうした知識表現は、人間には「やりきれない」ことが知られている。この問題は古典的問題であり、「フレーム問題」と呼ばれる。

人工知能学会のホームページ[1]では、「フレーム問題」は次のように解説される。「チェスをするとか,機械を組み立てるとか,やろうとしていることを限定している人工知能では,このフレーム問題は生じませんし,このような状況では人工知能技術が実用化されています.しかし,いろいろな状況に対応できる人工知能ではこの問題は無視できません.」

この説明から「フレーム問題」の困難は、「演繹」をAIにさせることの難しさと同じだと、私には思われる。私がこう考える根拠の一つに、1980年代から日本で行われた第五世代コンピュータ開発計画(ICOT)を挙げる。これはまさに日本が国を挙げて、論理推論マシンを開発して、第2次人工知能ブームの花形だった「エキスパート・システム」(専門家の知識を入力した推論マシン)等を本気で実用化しようとした計画だった。しかしまさにこの「フレーム問題」が原因の一つとなって、この計画は成功しなかったともいわれる。そもそも、「エキスパート」(専門家)は自分が分かっていることの全部を、言葉では表現しきれない(これは「知識獲得のボトルネック」と呼ばれた[2])。そもそも人間が理解できていないことを、コンピュータにさせられると誰が、(つまりプログラミングしないで計算させられると誰が)考えるであろうか。

しかし、このような失敗や困難の原因を改めて認識することから、逆に次の世代でのAIの使い方や、人間とAIの付き合い方に、ヒントが得られるかもしれない。つまり人間とはどういうものか、人間がその理解を深める上でAIが役に立つかもしれない。そういう可能性である。

おわりに

AIからBIへという言葉がある。BIとはBasic Income、つまり国家による基礎所得保証である。これはAIを始めとする科学技術の進歩の上に構想される。スイスでは2016年6月5日にBIの投票が行われたが、反対約8割で否決された。国家防衛と勤勉を価値とするスイス人の姿が目に浮かぶようだ。他方でフィンランドでは、実験的に2017年と2018年の2年間、BI支給がすでに始まっている(無作為に選ばれた約2千人の失業中の市民が対象)。

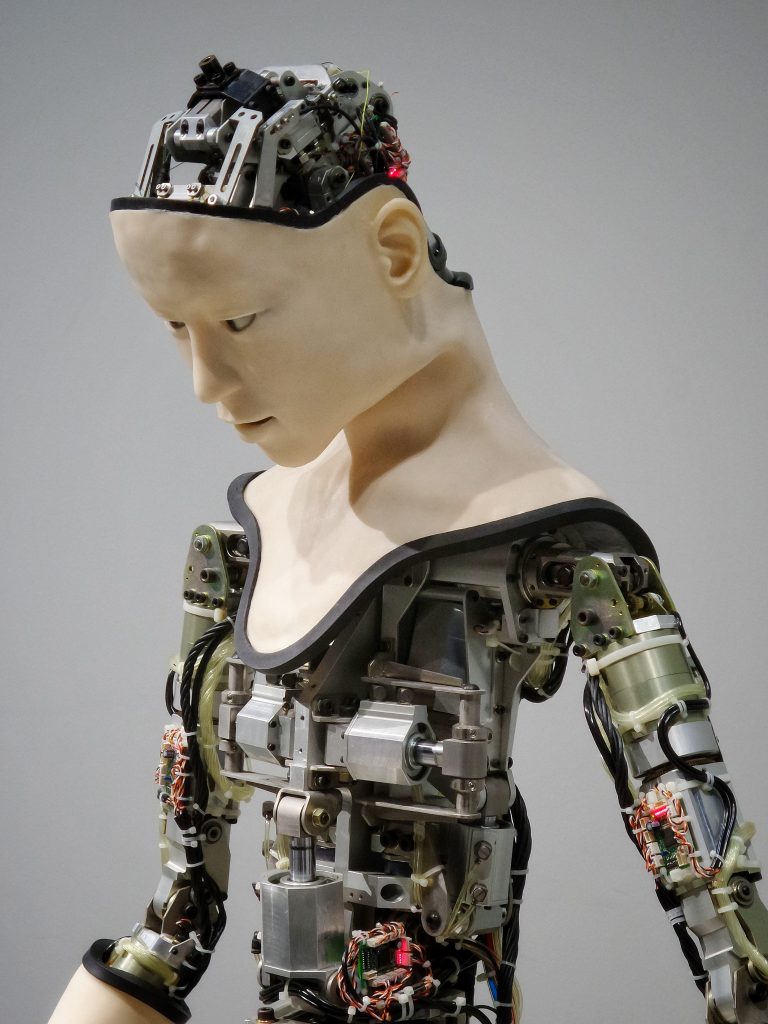

いまのAIは特化型AIと呼ぶ(英語ではnarrow AI、weak AIと呼ばれる)。これを、私はさんざん「アホ」と呼んできた。AIには申し訳なかったかもしれない。しかしそれは、「知能」と呼ぶにはあまりに貧弱である。動作条件は特定の土俵(例えば囲碁とか将棋とかボードゲームとか自動運転とか)に限定され、条件も決まった場合の、明晰判明に定義された「最適化関数」を書ける場合に、それを最適化(最大化)することにおいて、人間を上回り始めただけだ。たいした影響ではない。実際、いまのAIには「演繹」も出来ないし、まして「アブダクション」も出来はしない。

これに対して、鉄腕アトムやドラえもんのようなロボットが持つ人工知能は、汎用AIと呼ぶ(英語ではAGI: Artificial General Intelligence、strong AIと呼ばれる)。これは、簡単には設計できないであろうことは、上の議論から分かる。脳研究の進展にヒントを得て、脳型コンピュータの研究はすでに20年前から行われているが、まだまだという段階だ。しかし未来永劫、汎用型AIが出来ないとは言えない。

人間はいったい、どういう未来を望んでいるのだろうか。遊んで暮らせる社会だろうか。自己実現が大事なのだろうか。それは人間にしか分からない。いや人間にさえ、分かっていない。なぜなら人間は自分のことさえ、理解できないからだ。そもそも、これはなぜだろうか。

Googleに買収されたDeepMind社のDemis Hassabis氏(AlphaGoやAlphaGo Zero、Alpha Zeroの開発者)は、彼自身のAIの開発目的は「人類の大問題」(例えば環境問題、宇宙の謎、経済の課題、その他の未解決課題)の解決のためだと明言している[3](“Dream is to make AI scientists or AI-assisted science and medicine possible”)。デカルトがいうように、そのような大問題も明晰判明な問題に落とし込み、分析可能にできれば、あとは人類は好むように総合し、解決のための政策提言を出せるようになるかもしれない。あるいは、そうならないかもしれない。

「シンギュラリティサロン」[4]を主宰する松田卓也氏は、人類とロボットの戦争が起こると心配するのを、「ハリウッド的世界観」と呼ぶ[5]。しかし映画「ターミネータ」もコンピュータの暴走から始まったわけで、そんな戦争の可能性もゼロではないかもしれない。

私としては、科学者の端くれの一人として、科学技術の発展の結果、こんな時代になってきて、むしろ「やっと来たか」と思っている。なぜなら数千年来の謎が解けるかもしれないからだ。

しかしそうなっても人間の悩みは、なくならない気がする。なぜなら、分かることが増えれば増えるほど、ますます不思議が増えるのが人間だからだ。人間に悩みがなくなったら、そのときこそ、人類は滅びるだろうから、そうならないように、いつも悩みつつ、疑問を感じることにしたい。

そういえばデカルトは意図的に疑うことを「方法的懐疑」と呼ぶ。この「方法」はいつまで有効なのであろうか。

最後になったが、私自身は究極の「楽観主義者」であることを付記したい。AI時代の人間と社会、教育とビジネス、あるいは科学と技術については様々な考え方があるだろうし、それを考えることは有意義なことである。この問題について今後も、様々なところで多様な考察が展開されると思うが、このWebマガジンRad-It21がその目的にも有用であることを願っている。

(2018年6月6日)

謝辞:

私は2018年6月に「シンギュラリティサロン」で松田卓也氏(神戸大学名誉教授)にお会いして、今回のこのWebマガジン(案)をお伝えし、ご了解を得た。また関係者の根本茂氏(BBTower社)と保田充彦氏(ズームス社)にもご了解を得た。私は「シンギュラリティサロン」から多くのヒントを得ている。もって関係者各位に感謝したい。

参考資料

[1] 人工知能学会ホームページ、「人工知能の話題」、「フレーム問題」、https://www.ai-gakkai.or.jp/whatsai/AItopics1.htm [2] 堀浩一「知識の姿 − 人工知能研究者の立場から」『現代思想』Vol.19, No.6, pp.142-149, 1991. [3] 例えばDemis Hassabis (講演), “Explorations in Optimality”, “Beneficial AI 2017” 2017/04/12、あるいは “Artificial Intelligence and the Future”, RSA Replay, 2016/09/29など参照. [4] 「シンギュラリティサロン」、http://singularity.jp/ [5] 松田卓也『2045年問題 コンピュータが人類を超える日』、廣済堂新書、 2012.